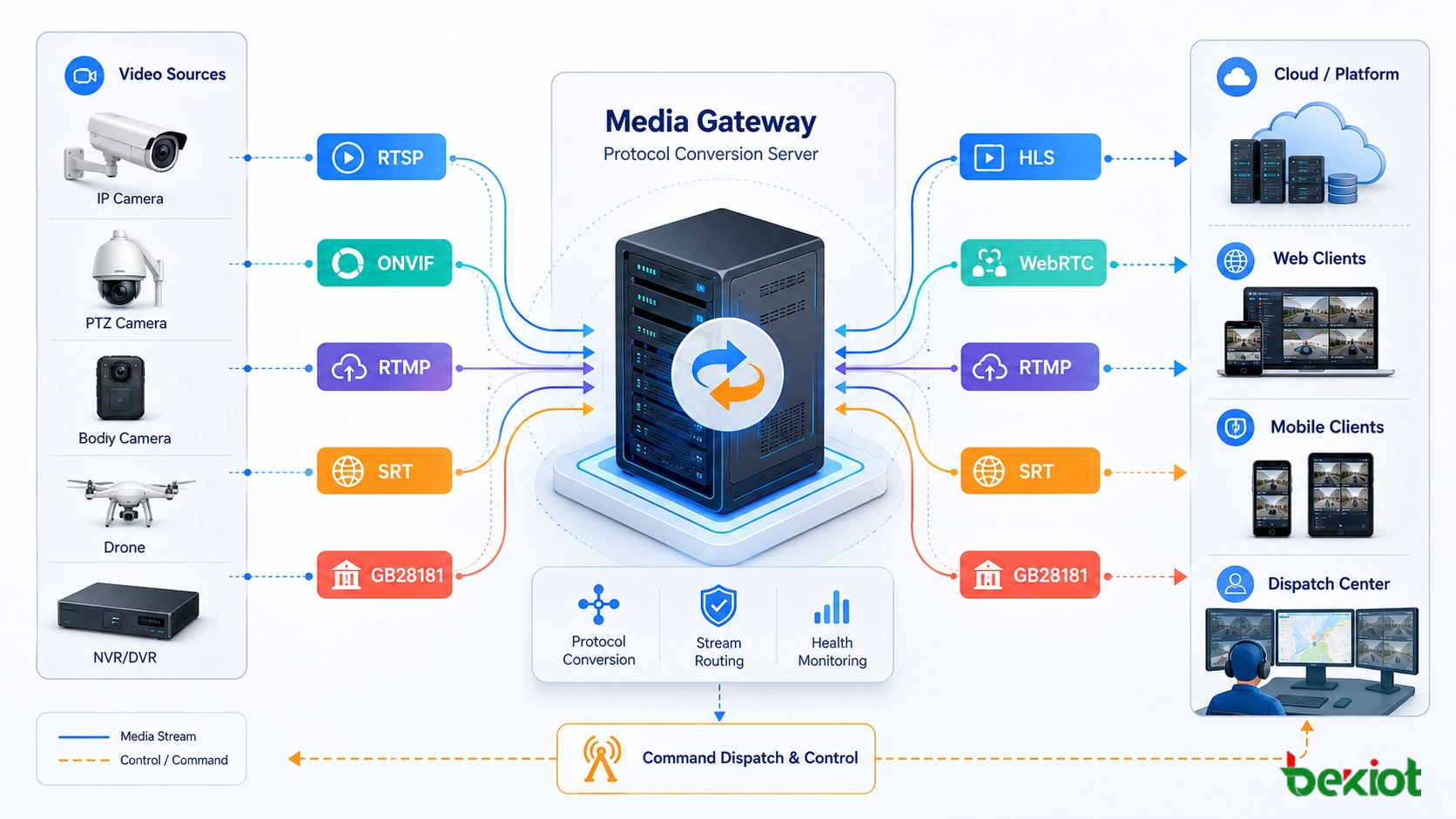

Ein videokonvergentes Kommunikationssystem wird nicht mit nur einem Videoprotokoll aufgebaut. In realen Projekten verwenden Kameras, NVRs, Videoplattformen, Dispatch-Konsolen, mobile Apps, Web-Clients, Drohnen, Kommandozentralen und Sicherheitssysteme von Drittanbietern oft unterschiedliche Übertragungsmethoden. Das Ziel des Systemdesigns besteht darin, diese Videoressourcen in einen verwaltbaren Arbeitsablauf einzubinden, statt jedes Gerät oder jede Plattform isoliert zu lassen.

In einem typischen Führungs- und Dispatch-Szenario können Live-Vorschau, Kommunikation mit niedriger Latenz, Videoaufzeichnung, Plattform-Kaskadierung, mobile Anzeige, Notfallverknüpfung und Remote-Sharing gleichzeitig erforderlich sein. Deshalb erscheinen Protokolle wie RTSP, RTP/RTCP, ONVIF, RTMP, HLS, WebRTC, SRT und GB28181 häufig gemeinsam in einem Projekt. Jedes Protokoll löst ein anderes Problem, und die endgültige Lösung hängt von Latenz, Kompatibilität, Bandbreite, Netzwerkbedingungen, Gerätezugriff und den Bedienanforderungen der Leitstelle ab.

Warum eine einzige Videomethode nicht ausreicht

Videokommunikationsprojekte bestehen meist aus mehreren Ebenen. Die Front-End-Ebene kann IP-Kameras, Bodycams, Drohnen, Mobiltelefone, Video-Gegensprechanlagen, NVRs, DVRs und intelligente Edge-Geräte umfassen. Die Plattformebene kann ein Videomanagementsystem, eine SIP-Dispatch-Plattform, ein Notfallführungssystem, einen Aufzeichnungsserver, ein Mediengateway oder einen Cloud-Dienst enthalten. Die Benutzerebene kann Kontrollraum-Bildschirme, Browser-Clients, mobile Apps, Dispatch-Konsolen und Kommando-Plattformen von Drittanbietern umfassen.

Diese Ebenen sprechen nicht immer dasselbe Protokoll. Eine Kamera kann RTSP-Streaming bereitstellen, während eine Sicherheitsplattform GB28181-Zugriff verlangt. Ein Browser kann WebRTC für Interaktion mit niedriger Latenz oder HLS für stabile Wiedergabe bevorzugen. Ein großes öffentliches Netzwerkübertragungsprojekt kann SRT benötigen, um die Zuverlässigkeit bei Paketverlust zu verbessern. Eine Drohne oder ein mobiles Gerät kann ein eigenes privates Übertragungsverfahren verwenden und danach RTMP, HTTP-API-Daten oder SDK-basierte Videostreams ausgeben.

Daher muss ein praktisches videokonvergentes Kommunikationssystem als Architektur zur Protokollkoordination ausgelegt werden. Es sollte Video aus verschiedenen Quellen empfangen, Streams bei Bedarf umwandeln, Signalisierung und Steuerung verwalten und das richtige Format an das passende Benutzerszenario liefern.

RTSP für den Zugriff auf Kamera- und NVR-Streams

RTSP, Real Time Streaming Protocol, ist eine der häufigsten Methoden, um Videostreams von IP-Kameras, NVRs, DVRs und vielen Videogeräten abzurufen. Es wird oft für Live-Vorschau, Geräte-Streaming, Plattformzugriff und internes Videorouting verwendet.

In vielen Projekten steuert RTSP die Videositzung, während die eigentlichen Mediendaten gewöhnlich über RTP übertragen werden. Je nach Gerät und Netzwerkumgebung kann der Stream TCP oder UDP verwenden. UDP kann die Verzögerung verringern, während TCP unter bestimmten Netzwerkbedingungen die Stream-Stabilität verbessern kann.

RTSP eignet sich für professionellen Videozugriff innerhalb eines LAN, privaten Netzwerks, Sicherheitssystems, industriellen Kontrollzentrums oder einer Dispatch-Plattform. Es ist jedoch nicht immer die beste Wahl für direkte Browserwiedergabe oder großflächige Verteilung über das öffentliche Internet. In solchen Fällen muss das System RTSP möglicherweise in WebRTC, HLS, RTMP oder ein anderes Auslieferungsformat umwandeln.

RTP und RTCP als Medientransportschicht

RTP, Real-time Transport Protocol, ist ein zentrales Medientransportverfahren, das von RTSP, SIP-Videoanrufen, WebRTC und anderen Echtzeitkommunikationssystemen verwendet wird. Es transportiert Audio- und Videopakete über das Netzwerk, meist über UDP, um Echtzeit-Medienübertragung zu unterstützen.

RTCP arbeitet zusammen mit RTP. Es liefert Rückmeldungen zur Übertragungsqualität, Paketstatistiken, Jitter-Informationen, Synchronisationsunterstützung und weitere Statusdaten. In einem Führungskommunikationssystem hilft dies Ingenieuren zu beurteilen, ob Verzögerung, Paketverlust oder Netzwerkinstabilität das Videoerlebnis beeinflussen.

RTP/RTCP wird normalerweise nicht direkt vom Endbenutzer bedient, ist aber grundlegend für die Systemleistung. Wenn das System Sprach-Video-Gegensprechen, Video-Dispatching, Notrufverknüpfung oder Echtzeitüberwachung benötigt, muss die Medienschicht sorgfältig getestet werden.

ONVIF für Geräteerkennung und Steuerung

ONVIF wird in Videoüberwachungsprojekten breit eingesetzt, weil es Plattformen hilft, IP-Kameras verschiedener Hersteller zu finden, anzubinden und zu steuern. Es ist besonders nützlich, wenn ein Systemintegrator Kameras verbinden muss, ohne von einem einzelnen Markenökosystem abhängig zu sein.

ONVIF wird häufig für Geräteerkennung, Abruf von Stream-Profilen, Authentifizierung, PTZ-Steuerung und Verwaltung von Kamerafunktionen verwendet. In vielen Installationen stellt ONVIF Gerätemanagement und Steuerung bereit, während der eigentliche Videostream weiterhin über RTSP abgerufen wird.

Für ein videokonvergentes Kommunikationssystem verbessert ONVIF Zugriffseffizienz und Kompatibilität. Dennoch müssen Ingenieure prüfen, ob jede Kamera das erforderliche ONVIF-Profil unterstützt, ob PTZ-Befehle korrekt funktionieren und ob das erwartete Stream-Format zuverlässig abgerufen werden kann.

RTMP für Stream-Push und Plattformverteilung

RTMP, Real-Time Messaging Protocol, war ursprünglich mit Adobe Flash verbunden, wird aber weiterhin häufig für Stream-Push, Live-Verteilung, Videoplattform-Eingang und einige Cloud-Mediendienste verwendet. Es wird oft genutzt, wenn ein Gerät oder eine Plattform Video an einen Medienserver senden muss.

RTMP bietet in der Regel geringere Verzögerung als HLS. In vielen praktischen Umgebungen kann die RTMP-Latenz je nach Netzwerkqualität, Serververarbeitung und Wiedergabekonfiguration etwa 1 bis 2 Sekunden betragen. Dadurch ist es für Live-Streaming und Plattformverteilung geeignet, wenn ultraniedrige Latenz nicht zwingend erforderlich ist.

In modernen Systemen wird RTMP oft in HLS, FLV, WebRTC oder andere Formate für die endgültige Wiedergabe umgewandelt. Es ist ein praktisches Brückenprotokoll, besonders wenn Front-End-Geräte oder mobile Encoder bereits RTMP-Ausgabe unterstützen.

HLS für Web-Wiedergabe und großflächige Anzeige

HLS, HTTP Live Streaming, wird häufig für Browserwiedergabe, mobile Anzeige, Webportale und großflächige Videoverteilung eingesetzt. Da es auf HTTP basiert, kann es über gängige Webports wie 80 und 443 arbeiten und ist für CDN-Verteilung, Firewall-Durchquerung und große Zuschauerzahlen geeignet.

Der Kompromiss ist die Latenz. HLS hat gewöhnlich eine höhere Verzögerung als RTMP oder WebRTC. In vielen Projekten liegt die typische Latenz bei etwa 5 bis 8 Sekunden, obwohl optimierte Konfigurationen sie in bestimmten Szenarien reduzieren können. Damit eignet sich HLS für stabile Anzeige, öffentliche Displays, Aufzeichnungswiedergabe, Web-Monitoring-Seiten und nicht interaktive Live-Vorschau.

HLS ist nicht immer für Notfall-Dispatch-Aktionen geeignet, die sofortige Reaktion erfordern. Wenn Bediener Echtzeit-Zweiwegeinteraktion oder schnelle Videobestätigung benötigen, kann WebRTC oder eine andere Methode mit niedriger Latenz passender sein.

WebRTC für Interaktion mit niedriger Latenz

WebRTC ist für Echtzeit-Audio- und Videointeraktion in Browsern und mobilen Anwendungen ausgelegt. Es wird häufig für Videoanrufe, browserbasiertes Dispatching, Videovorschau mit niedriger Latenz, Remote-Führungskommunikation, Video-Gegensprechen und interaktive Notfallreaktionsabläufe verwendet.

Ein großer Vorteil von WebRTC ist die Latenz. In geeigneten Netzwerkumgebungen kann WebRTC oft Verzögerungen von etwa 200 bis 500 Millisekunden erreichen. Das ist wertvoll für Kommandozentralen, Remote-Support, Video-Gegensprechen, KI-gestützte Überwachung und Situationen, in denen Bediener schnell sehen und reagieren müssen.

WebRTC bringt auch technische Herausforderungen mit sich. NAT-Traversal, Firewall-Richtlinien, Signalisierungsserver, TURN/STUN-Dienste, Browserkompatibilität, Codec-Aushandlung und Server-Parallelität müssen berücksichtigt werden. In professionellen Projekten sollte WebRTC als Teil der gesamten Systemarchitektur geplant und nicht als einfaches Player-Format betrachtet werden.

SRT für zuverlässige Übertragung über instabile Netzwerke

SRT, Secure Reliable Transport, wird verwendet, wenn Video über instabile oder weit entfernte Netzwerke übertragen werden muss. Es ist nützlich für Übertragung über das öffentliche Internet, entfernte Standorte, mobile Fahrzeuge, temporäre Kommando-Posten, standortübergreifende Videorückführung und Feldkommunikation, bei der Paketverlust und Jitter auftreten können.

SRT verbessert die Zuverlässigkeit durch Mechanismen wie ARQ und FEC. Diese Technologien helfen, verlorene Pakete wiederherzustellen und die Stream-Qualität bei Netzwerkschwankungen aufrechtzuerhalten. Für Notfallführung, Verkehr, industrielle Inspektion und Fernüberwachung kann dies zuverlässiger sein als einfaches UDP-Streaming.

SRT wird nicht immer für die finale Wiedergabe verwendet. In vielen Lösungen dient es als robustes Beitrags- oder Backhaul-Protokoll und wird anschließend auf der Medienplattform in WebRTC, HLS, RTMP, GB28181 oder andere von Nutzern und Plattformen benötigte Formate umgewandelt.

GB28181 für die Interconnection von Sicherheitsplattformen

GB28181 wird in Chinas Videoüberwachungs- und Public-Safety-Integrationsprojekten breit eingesetzt. Es ist wichtig, wenn Videoressourcen mit Sicherheitsplattformen, Regierungssystemen, Kommandozentralen oder mehrstufigen Videonetzwerkplattformen verbunden werden müssen.

Technisch basiert GB28181 auf SIP, SDP und RTP. SIP übernimmt Registrierung, Signalisierung, Gerätezugriff und Sitzungssteuerung. SDP beschreibt die Mediensitzung, während RTP den Medienstream transportiert. Dadurch eignet sich GB28181 für Plattform-Kaskadierung, Geräteregistrierung, Live-Ansicht, Wiedergabe, Steuerung und mehrstufiges Teilen von Videoressourcen.

In konvergenten Kommunikationsprojekten ist GB28181 häufig der Schlüssel, um Überwachungsvideo mit Führungs- und Dispatch-Abläufen zu verbinden. Vor der Bereitstellung müssen jedoch Lizenzen, Plattformberechtigungen, Geräte-ID-Planung, Netzwerkrouting, Medienkompatibilität und Zugriffsregeln zwischen Plattformen bestätigt werden.

Drohnen und private Videozugangsmethoden

Manche Feldsysteme verwenden Drohnen, Bodycams, mobile Terminals, KI-Videogeräte oder herstellerspezifische Übertragungsmodule. Diese Geräte können private Protokolle wie OcuSync, LightBridge, SDK-basierte Übertragung, proprietäre UDP-Medien, HTTP-API-Ausgabe, RTMP-Push oder Cloud-Relay-Methoden nutzen.

In einer konvergenten Kommunikationslösung benötigen diese Geräte meist ein Zugriffsgateway oder einen Plattformadapter. Ziel ist es, private oder gerätespezifische Videoressourcen in Standardstreams umzuwandeln, die angezeigt, disponiert, aufgezeichnet, geteilt oder mit Alarmen verknüpft werden können.

Dieser Projektteil sollte früh geprüft werden. Auch wenn ein Gerät Video in seiner eigenen App anzeigen kann, unterstützt es nicht automatisch den Zugriff durch Drittplattformen. Ingenieure sollten SDK-Verfügbarkeit, Stream-Ausgabemethode, Authentifizierung, Latenz, Auflösung, Bitrate und Aufzeichnungsanforderungen bestätigen.

Wie Becke Telcom in die Lösung passt

Becke Telcom kann in Projekten berücksichtigt werden, in denen Videokommunikation mit SIP-Sprache, Industrietelefonie, Notfallbeschallung, Kommando-Dispatching, Funkanbindung, Alarmverknüpfung und Kontrollraumbetrieb zusammenarbeiten muss. In solchen Lösungen ist Video keine isolierte Überwachungsressource, sondern Teil eines umfassenderen Notfallkommunikations- und Dispatch-Workflows.

Für Industrieparks, Tunnel, Häfen, Energieanlagen, Campus, Verkehrsanlagen und Notfallzentren können Becke-Telcom-Lösungen helfen, Videovorschau, Sprachdispatching, SIP-Endpunkte, Paging, Alarme und Leitstellenbetrieb zu integrieren. Die endgültige Konfiguration sollte nach Kamerazugriffsmethoden, Plattformprotokollen, Latenzanforderungen, Benutzerzahl, Aufzeichnungsbedarf und Drittintegrationsbedingungen ausgewählt werden.

Eine zuverlässige videokonvergente Kommunikationslösung sollte jedes Protokoll der richtigen Aufgabe zuordnen: Gerätezugriff, Echtzeitinteraktion, stabile Webanzeige, plattformübergreifende Vernetzung oder Langstreckenübertragung.

Das richtige Protokoll je nach Szenario wählen

Für den Kamerazugriff

RTSP und ONVIF werden häufig zum Verbinden von IP-Kameras und NVRs verwendet. ONVIF hilft bei Erkennung und Steuerung, während RTSP normalerweise den Live-Videostream liefert.

Für Browser- und mobile Anzeige

HLS eignet sich für stabile Webanzeige und großflächige Verteilung. WebRTC ist geeigneter, wenn niedrige Latenz und Interaktion erforderlich sind.

Für Plattform-Push und Stream-Ingest

RTMP ist weiterhin nützlich, um Streams an Medienserver, Live-Plattformen und zwischengeschaltete Mediengateways zu senden. Danach kann es für die Wiedergabe in andere Formate umgewandelt werden.

Für Langstrecken-Rückführung aus dem Feld

SRT eignet sich für unzuverlässige Netzwerke, entfernte Standorte, temporäre Kommandofahrzeuge und Feldvideorückführung, bei der Paketverlust und Jitter die Qualität beeinflussen können.

Für Kaskadierung von Sicherheitssystemen

GB28181 eignet sich, um Kameras und Videoplattformen mit Public-Safety-, Regierungs- oder mehrstufigen Überwachungssystemen zu verbinden.

Technische Prüfungen vor der Bereitstellung

Vor Projektbeginn sollten Ingenieure alle Front-End-Videoquellen, Plattform-Schnittstellen, Stream-Formate, Codec-Typen, Bitraten, Auflösungen, Bildraten, Authentifizierungsmethoden, Firewall-Regeln, Netzwerktopologie, Speicheranforderungen und Anzeige-Szenarien bestätigen.

Auch Latenzerwartungen müssen geklärt werden. Eine Monitoring-Wand kann mehrere Sekunden Verzögerung akzeptieren, während eine Remote-Führungssitzung oder ein Video-Gegensprechanruf möglicherweise eine Reaktion unter einer Sekunde benötigt. Das Protokoll sollte nach dem operativen Bedarf und nicht nur nach Geräteverfügbarkeit gewählt werden.

Tests sollten Live-Vorschau, Mehrbildschirmanzeige, PTZ-Steuerung, Wiedergabe, Aufzeichnung, Browserzugriff, mobilen Zugriff, Paketverlustsimulation, Firewall-Traversal, Plattform-Kaskadierung und Benutzerberechtigungen umfassen. So wird vermieden, dass ein Stream im Labor funktioniert, aber bei der realen Leitstellenbereitstellung ausfällt.

Fazit

Ein videokonvergentes Kommunikationssystem hängt von einer Kombination von Protokollen ab, nicht von einer einzelnen Videotechnologie. RTSP und ONVIF sind nützlich für Kamerazugriff, RTP/RTCP unterstützt Echtzeit-Medientransport, RTMP hilft beim Stream-Push, HLS unterstützt stabile Webanzeige, WebRTC ermöglicht Interaktion mit niedriger Latenz, SRT verbessert die Übertragungszuverlässigkeit in instabilen Netzwerken, und GB28181 unterstützt Videonetzwerke auf Plattformebene.

Die beste Lösung besteht nicht darin, jedes Protokoll überall einzusetzen, sondern jedem Protokoll die richtige Rolle zuzuweisen. Mit gutem Mediengateway-Design, Plattformintegration, Tests und Planung der Führungsabläufe können Videoressourcen Teil eines einheitlichen Kommunikationssystems werden, das Überwachung, Dispatching, Notfallreaktion, Aufzeichnung und systemübergreifende Zusammenarbeit unterstützt.

FAQ

Welches Videoprotokoll ist am besten für Führungskommunikation mit niedriger Latenz?

WebRTC wird normalerweise für browser- oder appbasierte Interaktion mit niedriger Latenz bevorzugt. Unter geeigneten Netzwerkbedingungen kann es oft etwa 200 bis 500 Millisekunden Verzögerung erreichen und ist daher für Video-Gegensprechen und Notfallführung geeignet.

Reicht RTSP für ein vollständiges videokonvergentes Kommunikationssystem aus?

Nein. RTSP ist nützlich zum Abrufen von Kamerastreams, aber ein vollständiges System kann zusätzlich ONVIF für Gerätesteuerung, HLS für Webwiedergabe, WebRTC für niedrige Latenz, SRT für zuverlässige Langstreckenrückführung und GB28181 für Plattformvernetzung benötigen.

Warum ist GB28181 in Videointegrationsprojekten wichtig?

GB28181 ist wichtig, wenn Videoressourcen mit Sicherheitsplattformen, Regierungssystemen oder mehrstufigen Überwachungsplattformen verbunden werden müssen. Es nutzt SIP, SDP und RTP für Registrierung, Signalisierung und Medienübertragung.

Wann sollte SRT verwendet werden?

SRT eignet sich für Langstrecken- oder instabile Netzwerkübertragung, etwa entfernte Standorte, temporäre Kommandofahrzeuge, Feldeinsätze und interregionale Videorückführung, bei der Paketverlust und Jitter auftreten können.

Was sollte vor der endgültigen Abnahme getestet werden?

Das Projektteam sollte Stream-Zugriff, Latenz, Codec-Kompatibilität, PTZ-Steuerung, Aufzeichnung, Wiedergabe, Browserzugriff, mobile Anzeige, Firewall-Traversal, Plattform-Kaskadierung, Benutzerrechte und reale Netzwerkstabilität testen.