Konvergente Kommunikationssysteme werden in Notfallführung, öffentlicher Sicherheit, Feuerwehr, industriellem Dispatch, Verkehr und großen Sicherheitsprojekten eingesetzt. Ein Disponent kann Sprache, Funk, Video, Alarme und Feldressourcen über eine Plattform koordinieren.

In vielen Projekten zeigt sich jedoch ein verstecktes Problem: Videokompatibilität ist schwieriger als erwartet. Es geht nicht nur um Netzwerkzugang der Kamera, sondern um Codecs, Protokolle, Terminal-Decoding, Browserunterstützung und Echtzeitverhalten.

Die versteckte Lücke in Unified-Dispatch-Projekten

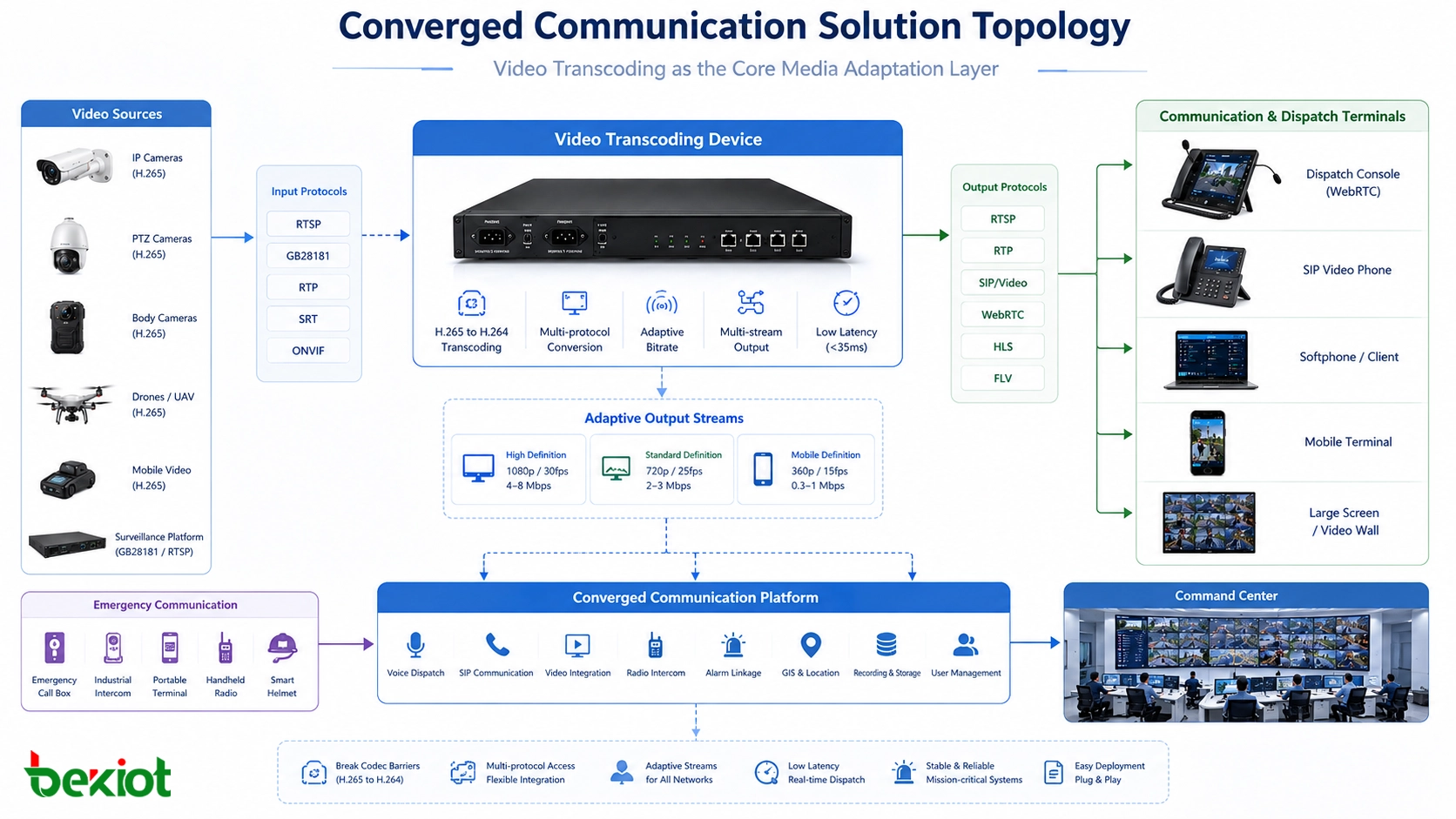

Viele Projekte werden um eine einheitliche Leitplattform mit Sprachdispatch, Videokonferenz, SIP-Anrufen, Funkintegration, Alarmen, GIS und Videoüberwachung herum geplant.

Im Systemdiagramm scheint alles verbunden zu sein. In der realen Bereitstellung treten Kompatibilitätsprobleme jedoch oft genau beim Videozugriff auf. Ein Stream, der im VMS stabil läuft, funktioniert nicht automatisch in einer WebRTC-Konsole oder einem Kommunikationsterminal.

Kamera, Plattform, Browser, Terminal und Medienserver können unterschiedliche Formate, Protokolle und Decoder verwenden. Deshalb muss die Videoschicht Teil der Kernarchitektur sein.

Die Ursache liegt in der Videocodierung

Überwachungssysteme haben sich stark in Richtung H.265 entwickelt. Bei ähnlicher Bildqualität kann H.265 die Bitrate gegenüber H.264 fast halbieren.

In Städten, Industrieparks, Verkehr, Energieanlagen und Sicherheitsprojekten reduziert das Netzwerk- und Speicherlast erheblich.

Konvergente Kommunikationsplattformen arbeiten jedoch oft mit WebRTC. In wichtigen Browsern ist H.265-Unterstützung weiterhin nicht vollständig, wodurch ein direkter Konflikt entsteht.

Warum WebRTC nicht jeden Kamerastream dekodiert

WebRTC ist beliebt, weil es Echtzeit-Audio und -Video über Browser und Softwareclients ermöglicht. Es eignet sich für Dispatchkonsolen, Videoanrufe, Zusammenarbeit und Leitstellen.

Es löst aber nicht automatisch alle Formatprobleme. Viele Kameras liefern H.265, während WebRTC-Umgebungen häufig H.264 oder andere browserfähige Formate erwarten.

Auch Endgeräte sind betroffen. Viele IP-Telefone, Dispatchterminals, Softwareclients und Feldgeräte besitzen keine starke H.265-Hardwaredekodierung.

In einem konvergenten Projekt zählt nicht nur, ob ein Videostream existiert. Entscheidend ist, ob jedes erforderliche Terminal ihn in Echtzeit dekodieren, anzeigen und nutzen kann.

Medienserver sind nicht immer für Echtzeitkonvertierung gebaut

Viele Plattformen basieren auf reifen SIP- und Medienframeworks und sind stark bei Sprache, Signalisierung, Konferenzen und Rufsteuerung.

Videotranskodierung ist jedoch deutlich schwerer als Audio-Weiterleitung. Oft leitet der Medienserver Video nur weiter und ist nicht für große Echtzeitkonvertierung optimiert.

Wird diese Aufgabe in den Kernserver verlagert, steigen Komplexität und Stabilitätsrisiko. Ein dediziertes Gerät übernimmt die Konvertierung vor Plattform oder Terminal.

Eine dedizierte Konvertierungsschicht wird notwendig

Bei Projekten mit Videoüberwachung sollte der Transcoder als Infrastruktur gelten. Er übersetzt Videoformate zwischen Überwachungsnetz und Kommunikationsnetz.

Er wandelt H.265-Streams von Kameras, mobilen Quellen, Rekordern, temporären Geräten oder bestehenden Plattformen in H.264 oder andere Zielformate um.

Echtzeitverhalten ist kritisch. Im Kommando darf Video nicht deutlich hinter Sprachbefehlen liegen; die Latenz muss für operative Entscheidungen niedrig bleiben.

Adaptive Streams sind für verschiedene Terminals wichtig

Codec-Konvertierung ist nur ein Teil. Terminals reichen von HD-Leitstellenbildschirmen im Gigabit-LAN bis zu mobilen Geräten im 4G-Netz.

Das Gerät sollte Auflösung, Bildrate und Bitrate anpassen und aus einer Quelle mehrere Profile erzeugen.

Ein einziger schwerer Stream für alle führt zu Einfrieren, Verzögerung oder Ausfällen. Adaptive Transkodierung verbessert die Nutzbarkeit.

Protokollfragmentierung ist eine weitere Barriere

Konvergente Systeme kombinieren oft SIP, GB/T 28181, RTP, RTSP, FLV, HLS, WebRTC und weitere Protokolle.

Jedes Protokoll kann zu anderen Plattformen, Geräten oder Herstellern gehören. Ein Transcoder darf daher nicht nur H.265 in H.264 wandeln.

Flexible Ein- und Ausgänge reduzieren Sonderentwicklung und erleichtern die Verbindung von Kameras, Plattformen, Browsern, mobilen Clients und Kommunikationssystemen.

So sieht eine praktische Architektur aus

Der Transcoder wird typischerweise zwischen Videoüberwachung und Kommunikationsplattform platziert.

Eingangsseitig empfängt er Streams von Kameras, GB/T-28181-Plattformen, RTSP-Quellen oder anderen Systemen; ausgangsseitig liefert er Streams für WebRTC-Konsolen, SIP-Videoterminals, Browser und Leitbildschirme.

Die Dispatchplattform konzentriert sich auf Arbeitsabläufe, Benutzer, Anrufe, Alarme und Logik, während die Transkodierungsschicht Medien, Protokolle und Anpassung übernimmt. Becke Telcom kann dies in konvergente Lösungen integrieren.

Risiken, wenn Transkodierung ignoriert wird

Transcoder werden oft unterschätzt, weil sie weniger sichtbar sind als Konsolen, Rekorder, Videowände oder Terminals.

Bei der Lieferung treten dann Codec-Mismatch, Browserfehler, Decodergrenzen, zu hohe Bitraten, fehlende Protokolle oder instabile Weiterleitung auf.

Diese Probleme schwächen die Führungsfähigkeit. In der Abnahme zählen schnelle Öffnung, klare Bilder, akzeptable Latenz und Anzeige auf verschiedenen Terminals.

Auswahlfaktoren für das Projektdesign

Zunächst müssen Eingangsquellen geprüft werden: Codec, Protokoll, Auflösung, Bildrate, Bitrate und Zugangsmethode. H.265 ist besonders wichtig.

Danach sind Ausgänge zu klären: H.264, WebRTC-kompatible Streams, HLS für Browser, RTSP für interne Systeme oder andere Formate mit mehreren Profilen.

Schließlich muss reales Verhalten getestet werden: niedrige Latenz, stabiles Decoding, flüssiges Umschalten und Mehrterminalzugriff unter echten Netzbedingungen.

| Designbereich | Kernanforderung | Projektwert |

|---|---|---|

| Codec-Konvertierung | H.265 in H.264 oder andere Formate wandeln | Macht Überwachungsvideo für WebRTC und Terminals nutzbar |

| Niedrige Latenz | Verzögerung für Dispatch geeignet halten | Verhindert, dass Video Entscheidungen hinterherläuft |

| Adaptive Ausgabe | Auflösung, Bildrate und Bitrate anpassen | Verbessert Zugriff in LAN, 4G und Mischumgebungen |

| Protokollkompatibilität | SIP, GB/T 28181, RTP, RTSP, FLV, HLS, WebRTC unterstützen | Reduziert Integrationsaufwand |

| Systemintegration | Mit Plattformen, Video, Browsern und Terminals arbeiten | Macht Video zu einem zuverlässigen Teil der Leitstelle |

Wo diese Schicht besonders nützlich ist

Videotranskodierung ist wertvoll, wenn Überwachungsvideo in Kommunikations- oder Dispatchumgebungen genutzt werden muss: Notfallzentren, öffentliche Sicherheit, Industrie, Verkehr, Energie, Häfen, Minen, Campus und große Objekte.

Im Notfall verbessert Video das Lageverständnis; in der Industrie unterstützt es Inspektion und Sicherheit; im Verkehr hilft es bei Stationen, Tunneln und Wartung.

Die gemeinsame Anforderung lautet: Video muss im Kommunikationsworkflow nutzbar sein, nicht isoliert in einer separaten Überwachungsplattform.

Fazit

Ein echtes konvergentes Projekt kann sich nicht nur auf Sprachdispatch, SIP-Signalisierung und Plattformintegration verlassen. Wenn Videoüberwachung enthalten ist, gehört Transkodierung in die Architektur.

Ein dediziertes Gerät wandelt Codecs, passt Bitrate, Bildrate und Auflösung an und verbindet Protokolle wie SIP, GB/T 28181, RTP, RTSP, FLV, HLS und WebRTC.

Für Ingenieure ist die Lehre klar: Videotranskodierung ist keine Zusatzfunktion, sondern die Grundlage, damit Überwachungsvideo in konvergenter Kommunikation praktisch, echtzeitfähig und zuverlässig wird.

FAQ

Warum brauchen konvergente Projekte Videotranskodierung?

Weil viele Kameras H.265 liefern, während WebRTC-Konsolen, Browser, IP-Telefone und Terminals H.265 nicht zuverlässig dekodieren.

Ist H.265 besser als H.264?

H.265 spart Speicher und Bandbreite, aber H.264 wird von vielen Kommunikationsgeräten und Browsern breiter unterstützt.

Kann die Plattform selbst transkodieren?

Nicht immer. Echtzeit-Videotranskodierung ist ressourcenintensiv; ein dediziertes Gerät ist oft stabiler.

Welche Protokolle sollte ein Gerät unterstützen?

SIP, GB/T 28181, RTP, RTSP, FLV, HLS, WebRTC und die projektbezogenen Videozugriffsabläufe.

Was passiert ohne Transkodierung?

Schwarze Bilder, nicht unterstützte Streams, hohe Latenz, unscharfes Video, instabile Wiedergabe oder Terminalprobleme können auftreten.